Résumez cet article avec :

Comme pour toute application logicielle « traditionnelle », l'observabilité est un facteur clé de succès lorsque vous intégrez l'IA dans vos systèmes. Les applications basées sur l'IA ont créé une nouvelle pile technologique, notamment des API plus imprévisibles ainsi que des bases de données vectorielles et des cadres d'orchestration (de données). Cette évolution technologique justifie un nouveau regard sur l'observabilité. Dans cet article, nous allons d'abord mettre en évidence les aspects classiques de l'observabilité, puis expliquer les étapes supplémentaires dont vous avez besoin pour surveiller votre application d'IA. Nous terminons en examinant quels outils d'observabilité open source et propriétaires sont disponibles.

Qu'est-ce que l'observabilité ?

En termes simples, l'observabilité signifie que nous pouvons comprendre pourquoi une application est lent ou interrompu. Ou, en termes fantaisistes, la capacité de comprendre les état sur la base de sorties, les données de télémétrie collectées. Les développeurs devraient être en mesure de poser des questions arbitraires à propos de leur application, même si elles n'étaient pas prévues, même une fois que celle-ci a déjà été déployée.

Alors, quelle est la différence entre surveillance et observabilité? L'observabilité va bien au-delà de la surveillance, car nous voulons le savoir pourquoi notre système se comporte comme il le fait. Nous aimerions connaître les cause première du problème, plutôt que de simplement surveiller son comportement.

En quoi LLM Observability diffère-t-il ?

Une application utilisant des LLM se comporte en partie de la même manière qu'une application logicielle classique, mais cela ajoute un niveau de complexité. Principalement parce que les LLM sont par nature imprévisibles. Les modèles d'IA sont souvent des boîtes noires, dans lesquelles nous ne pouvons pas vraiment regarder à l'intérieur pour voir ce qui se passe. Bien que la sortie puisse être contrôlée et légèrement modifiée, nous ne pouvons faire aucune hypothèse à ce sujet. En outre, dans de nombreuses applications d'IA, les entrées d'un LLM peuvent également varier considérablement, car les invites sont souvent générées par les utilisateurs ou d'autres LLM.

Ainsi, en plus de l'observabilité « traditionnelle », nous devons ajouter une télémétrie spécifique pour les LLM. Nous devrons examiner les entrées et les sorties et les comparer à une base de référence ou à d'autres critères de référence réalisés dans le passé. De cette façon, nous pouvons déduire où les erreurs sont survenues, retrouver rapidement la cause première et voir si les réponses du modèle s'écartent de la ligne de base ou se comportent de manière inattendue (précision et hallucinations, par exemple).

Un autre aspect important est le suivi des coûts, car ceux-ci sont également plus difficiles à prévoir que dans les systèmes traditionnels, en particulier lorsque plusieurs LLM sont combinés ou lorsqu'ils sont utilisés dans un agentique configuration.

« Selon le rapport d'observabilité Elastic 2024, 69 % des entreprises ont du mal à gérer le volume de données généré par les systèmes d'IA, ce qui rend l'observabilité essentielle pour gérer la complexité et les coûts » (galileo)

Nous pouvons résumer les principaux aspects « traditionnels » de l'observabilité comme suit :

- Collecte de données complète: collecte de métriques, de journaux, de traces et d'événements provenant de tous les composants d'un système logiciel. Cela inclut les mesures des coûts de nos appels d'API externes.

- Surveillance en temps réel: Suivi continu des performances et du comportement du système afin de détecter les problèmes au fur et à mesure qu'ils surviennent

- Analyse des causes profondes: Identification rapide de la source des problèmes dans les systèmes complexes et distribués

Remarque : il y a certainement plus que cela, mais ce sont les plus importants.

Pour les LLM, nous notons les aspects suivants de l'observabilité :

- Métriques et évaluation du LLM : Métriques et évaluation du LLM : Mesurer la qualité de sortie LLM à l'aide de paramètres clés tels que l'exactitude, la précision, le rappel et le score F1. Cela inclut également la surveillance des hallucinations de nos modèles.

- Performances de récupération (RAG) Les performances de récupération dans l'observabilité LLM se concentrent sur l'évaluation de l'efficacité du composant de récupération dans les systèmes de génération augmentée de récupération (RAG), en évaluant des paramètres tels que la pertinence du contexte, le rappel et la précision

Meilleures pratiques en matière d'observabilité du LLM

Pour surveiller efficacement les systèmes d'IA, il est important de disposer d'un plan bien pensé. L'un des aspects clés est la création d'une boucle de rétroaction qui permet des améliorations continues. Cela implique de mettre régulièrement à jour les modèles d'IA en fonction de leurs performances, afin de garantir leur flexibilité et leur efficacité. Il est également essentiel de sélectionner les bons indicateurs de performance et de définir des seuils d'alerte appropriés. Ces mesures doivent être pertinentes et correspondre aux objectifs de l'organisation, en concentrant les efforts de surveillance sur les aspects les plus importants de la performance et du comportement du système.

Alors que les systèmes d'IA deviennent de plus en plus complexes et traitent de plus grandes quantités de données, il est essentiel de disposer de solutions d'observabilité capables d'évoluer et de s'adapter. Cela garantit que les organisations peuvent continuer à surveiller efficacement leurs systèmes d'IA au fur et à mesure de leur croissance. En outre, il est important de promouvoir une culture de l'observabilité au sein de l'organisation. Cela implique de former les équipes à comprendre et à utiliser les données d'observabilité, ce qui peut grandement améliorer le succès de ces pratiques de surveillance.

Outils pour l'observabilité LLM

Il existe différents outils payants et open source parmi lesquels nous pouvons choisir. Certains, comme Datadog et Traceloop, s'appuient sur des outils d'observabilité déjà existants et sont étendus à l'observabilité LLM. Les facteurs à prendre en compte pour choisir le meilleur outil sont les suivants :

- Votre plateforme d'observabilité existante. Si votre outil existant fournit déjà l'observabilité de l'IA, il y a de bonnes raisons de l'explorer. Ou vérifiez si votre surveillance existante peut facilement s'intégrer à l'outil d'observabilité.

- Coûts Les solutions payantes peuvent rapidement augmenter les coûts, en particulier lorsque nous devons suivre une application multi-LLM à grande échelle. D'autre part, avec les solutions open source, nous devons prendre en compte l'hébergement, le développement et la disponibilité.

- Visualisation des données: Utilisez les fonctionnalités de visualisation pour représenter les tendances et les anomalies des données, ce qui facilite l'interprétation d'informations complexes

- Capacités d'alerte: L'outil doit être capable de configurer des alertes en temps réel pour surveiller les seuils de performance

- Analyse des coûts : Envisagez des outils qui permettent de suivre l'utilisation des jetons et de ventiler les coûts, en particulier pour les applications LLM gourmandes en ressources

- Prise en charge de la langue et du SDK Le langage que vous utilisez actuellement et la manière dont vous souhaitez intégrer l'observabilité dans votre infrastructure technologique sont importants.

Plateformes d'observabilité payantes

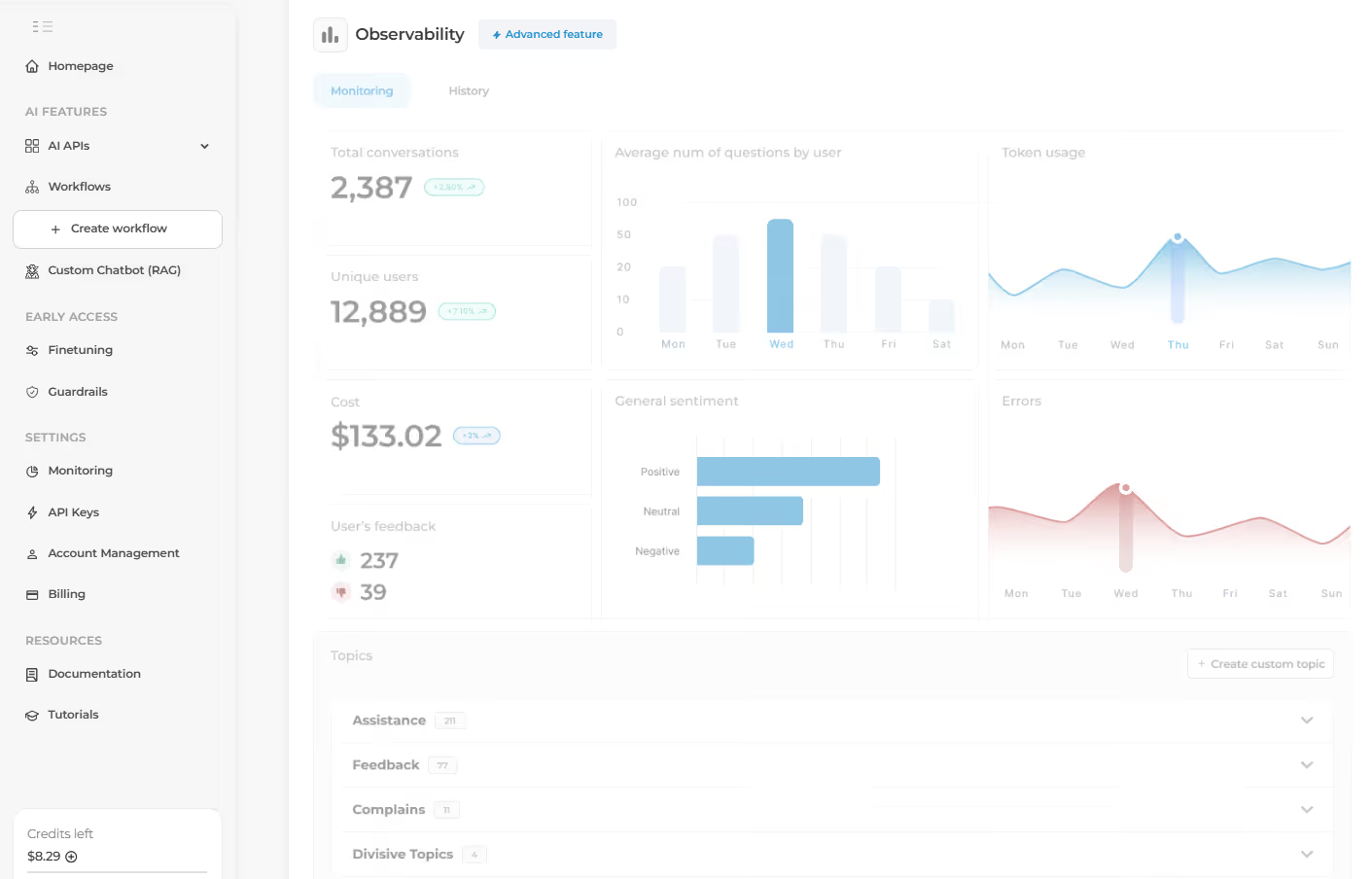

1. Outils d'observabilité et de surveillance Eden AI

Résumé : Une plateforme complète conçue pour améliorer les performances, la transparence et la fiabilité des systèmes d'IA, avec des outils avancés d'observabilité et de surveillance.

Caractéristiques :

- Surveillance en temps réel: suivez les temps de réponse, les taux d'erreur et l'utilisation des ressources en temps réel pour garantir le bon fonctionnement de l'IA.

- Détection d'anomalies: Identifiez et corrigez les anomalies à un stade précoce pour éviter les interruptions et maintenir la confiance dans les déploiements d'IA.

- Tableaux de bord centralisés: Accédez à une vue unifiée et intuitive de l'état et des performances de votre système d'IA.

- Compatibilité multimodèle et multifournisseur: Surveillez divers modèles d'IA sur de multiples plateformes, afin de garantir une intégration fluide.

- Suivi des journaux et analyses détaillées: approfondissez le comportement du système à l'aide de journaux et d'analyses complets pour une résolution efficace des problèmes.

- Alertes personnalisables: définissez des seuils spécifiques et recevez des alertes en temps réel pour garder une longueur d'avance sur les problèmes potentiels et maintenir des performances optimales.

Eden AI vise à simplifier la surveillance et l'observabilité de l'IA, en aidant les entreprises à optimiser leur efficacité, à renforcer la confiance et à garantir la responsabilité de leurs opérations d'IA.

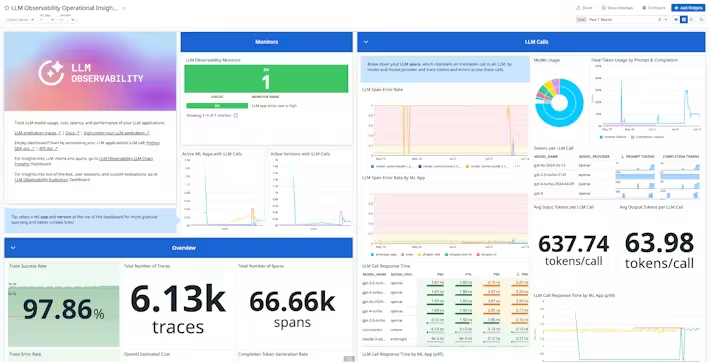

2. Plateforme d'observabilité Datadog LLM

Résumé :

Une plateforme complète pour la surveillance, le dépannage et l'évaluation des applications alimentées par LLM dans les environnements de production.

Caractéristiques :

- Traçage de bout en bout des chaînes LLM

- Surveillance des performances et des coûts en temps réel

- Évaluations de qualité et de sécurité

- Analyse des causes profondes des erreurs et des réponses inattendues

- Intégration à Datadog APM

- Clustering des réponses et des réponses

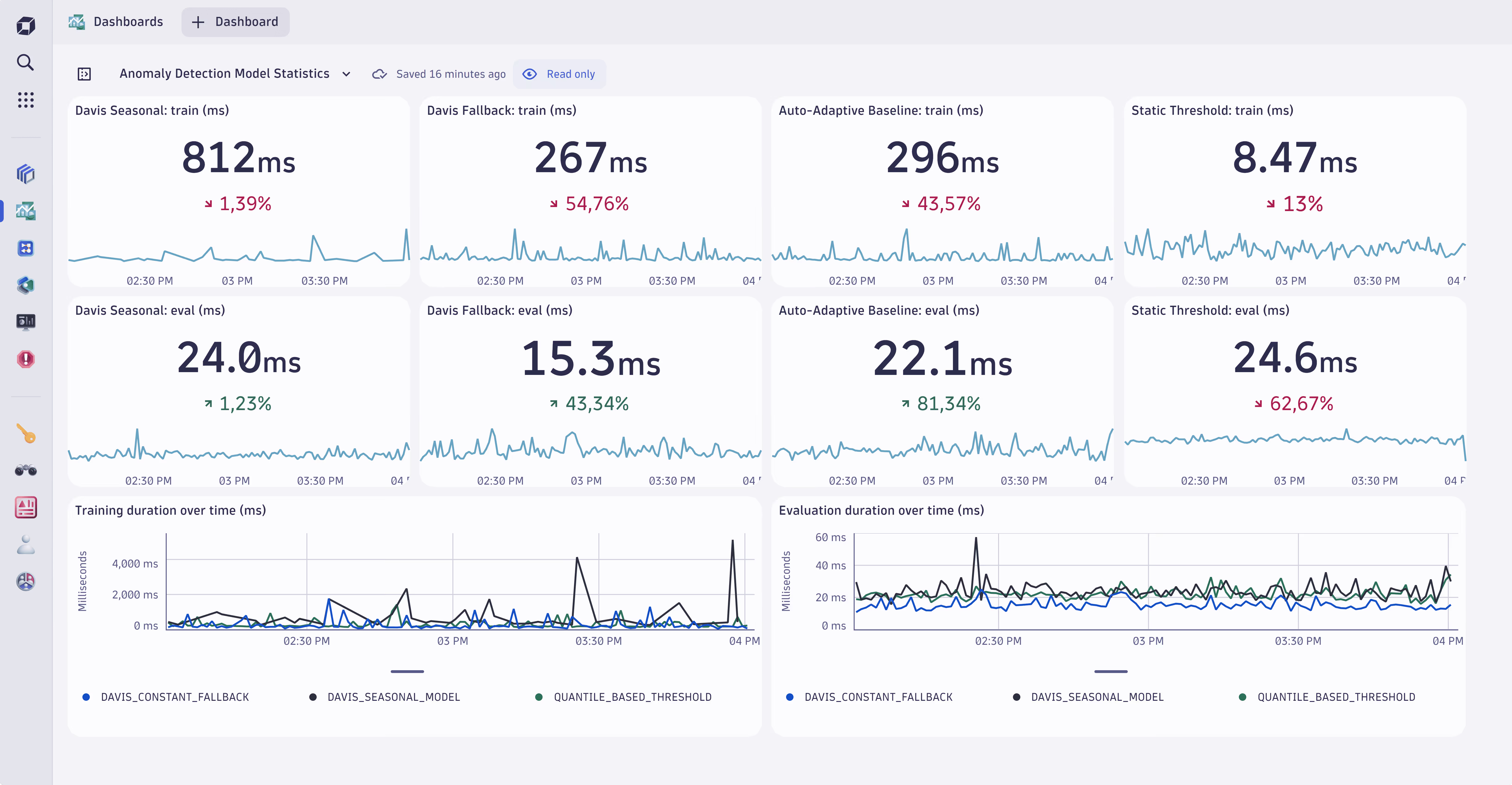

3. Application d'observabilité Dynatrace AI

Résumé :

Une solution d'observabilité pilotée par l'IA qui fournit des informations sur les applications basées sur l'IA, en mettant l'accent sur les performances, la sécurité et la conformité.

Caractéristiques :

- Vue précise des applications basées sur l'IA à l'aide de Davis AI

- Identification automatique des goulots d'étranglement en matière de performances

- Suivi de la conformité aux réglementations en matière de confidentialité et de sécurité

- Prévision et contrôle des coûts grâce à la surveillance de la consommation de jetons

- Cartographie topologique en temps réel sur l'ensemble de la pile

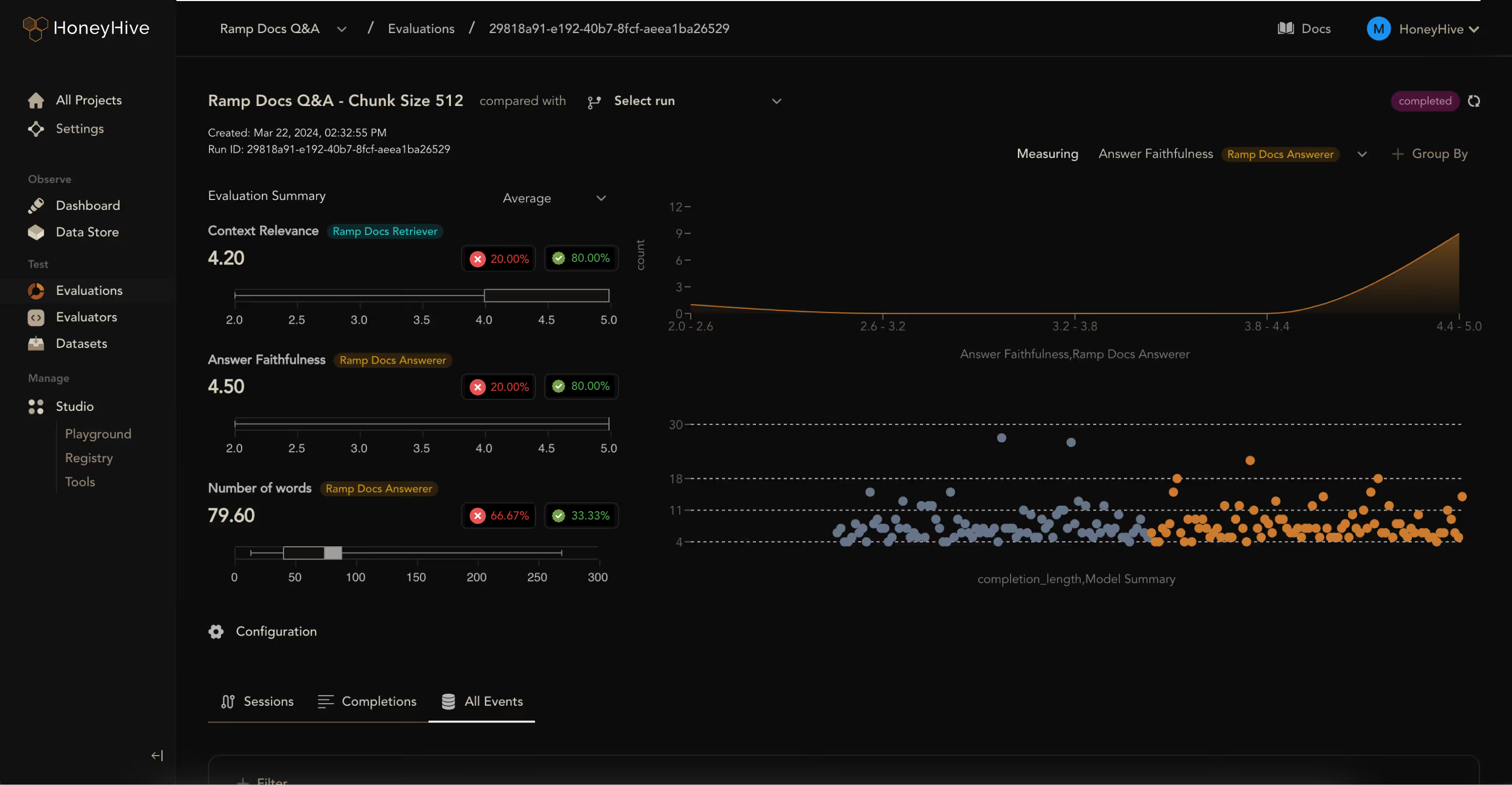

4. Plateforme d'évaluation HoneyHive

Résumé :

Une plateforme de développement d'IA proposant des outils pour déployer et améliorer en toute sécurité les LLM dans les environnements de production.

Caractéristiques :

- Outils de suivi et d'évaluation pour les agents LLM

- Suites de tests d'évaluation hors ligne

- Boîte à outils d'ingénierie rapide et collaborative

- Fonctionnalités de débogage pour les chaînes complexes, les agents et les pipelines RAG

- Analyse des causes profondes assistée par l'IA

- Registre des modèles et gestion des versions

- SDK non intrusif pour la confidentialité des données

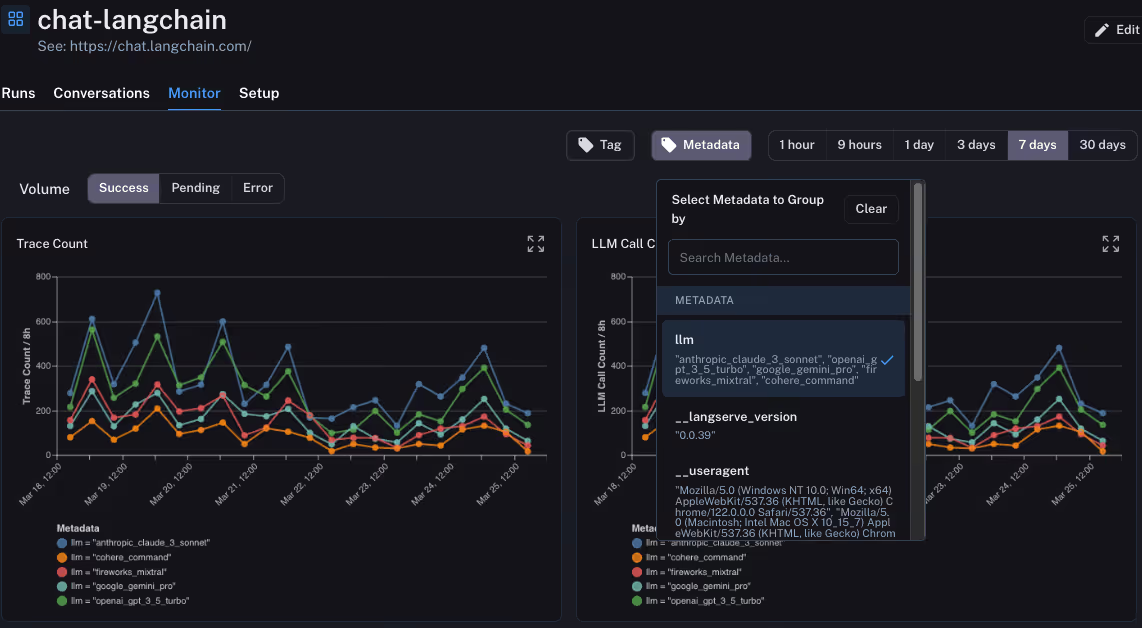

5. Lang Smith

Résumé :

Une plate-forme conçue pour créer des applications LLM de niveau production en mettant l'accent sur le suivi, l'évaluation et l'amélioration rapide.

Caractéristiques :

- Traçage des candidatures LLM pour une meilleure visibilité

- Évaluation des performances à travers les modèles, les instructions et les architectures

- Outils d'amélioration rapide

- Intégration fluide avec les frameworks LangChain

- Tableaux de bord de surveillance personnalisés

- Curation des ensembles de données pour une évaluation continue

- Simplification du processus d'évaluation humaine

Outils Open Source

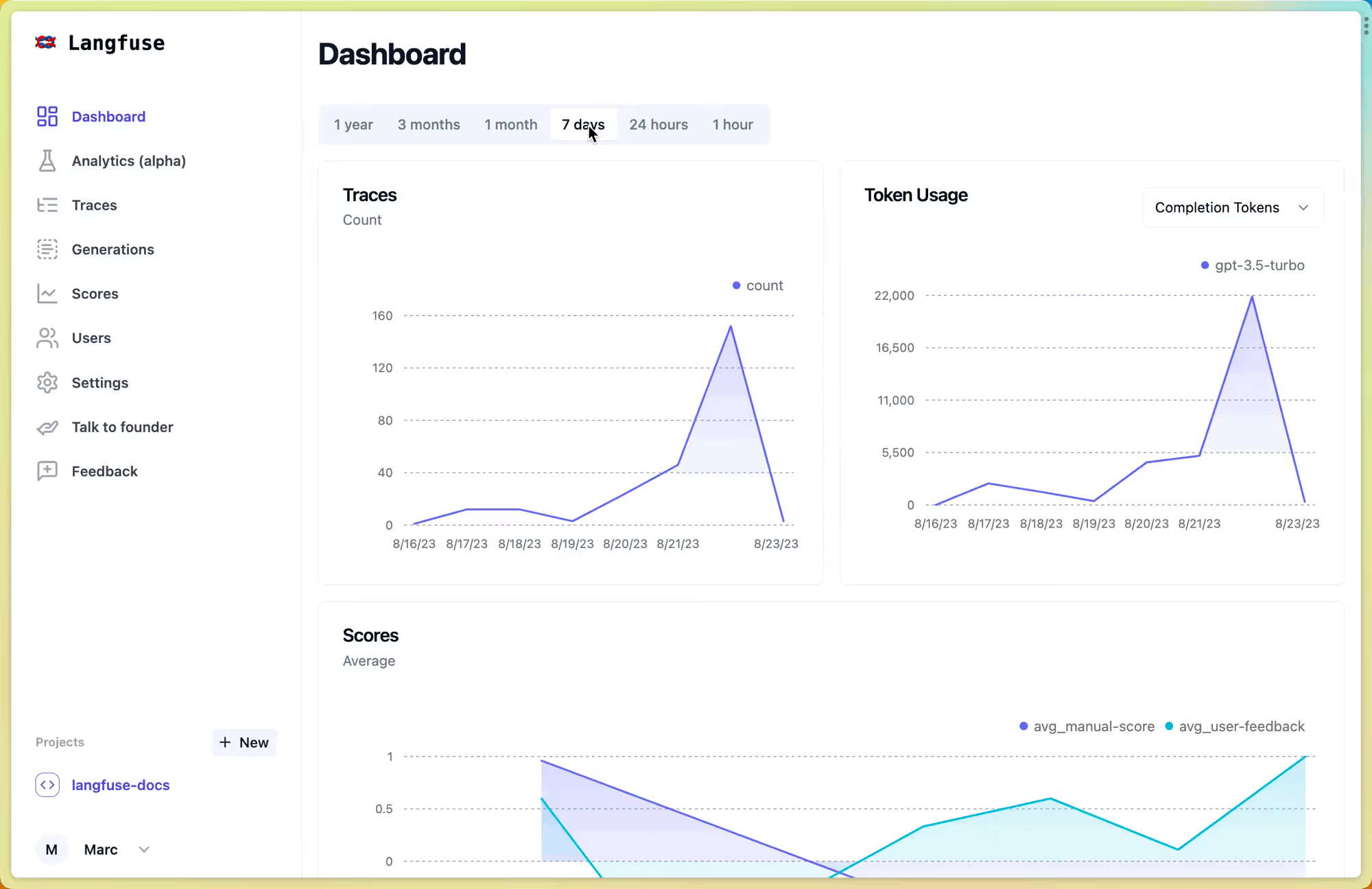

6. Langfuse

Résumé :

Plateforme d'ingénierie LLM open source offrant des fonctionnalités d'observabilité, d'analyse et d'expérimentation pour les applications LLM.

Caractéristiques :

- Surveillance en temps réel des appels LLM, des flux de contrôle et des processus de prise de décision

- Fonctionnalité de traçage pour le débogage et l'optimisation

- Suivi des coûts et de la latence

- Évaluation de la qualité grâce aux commentaires des utilisateurs et à la notation basée sur un modèle

- Regroupement des cas d'utilisation

- Intégration avec les frameworks LLM les plus populaires

- Options auto-hébergées ou basées sur le cloud

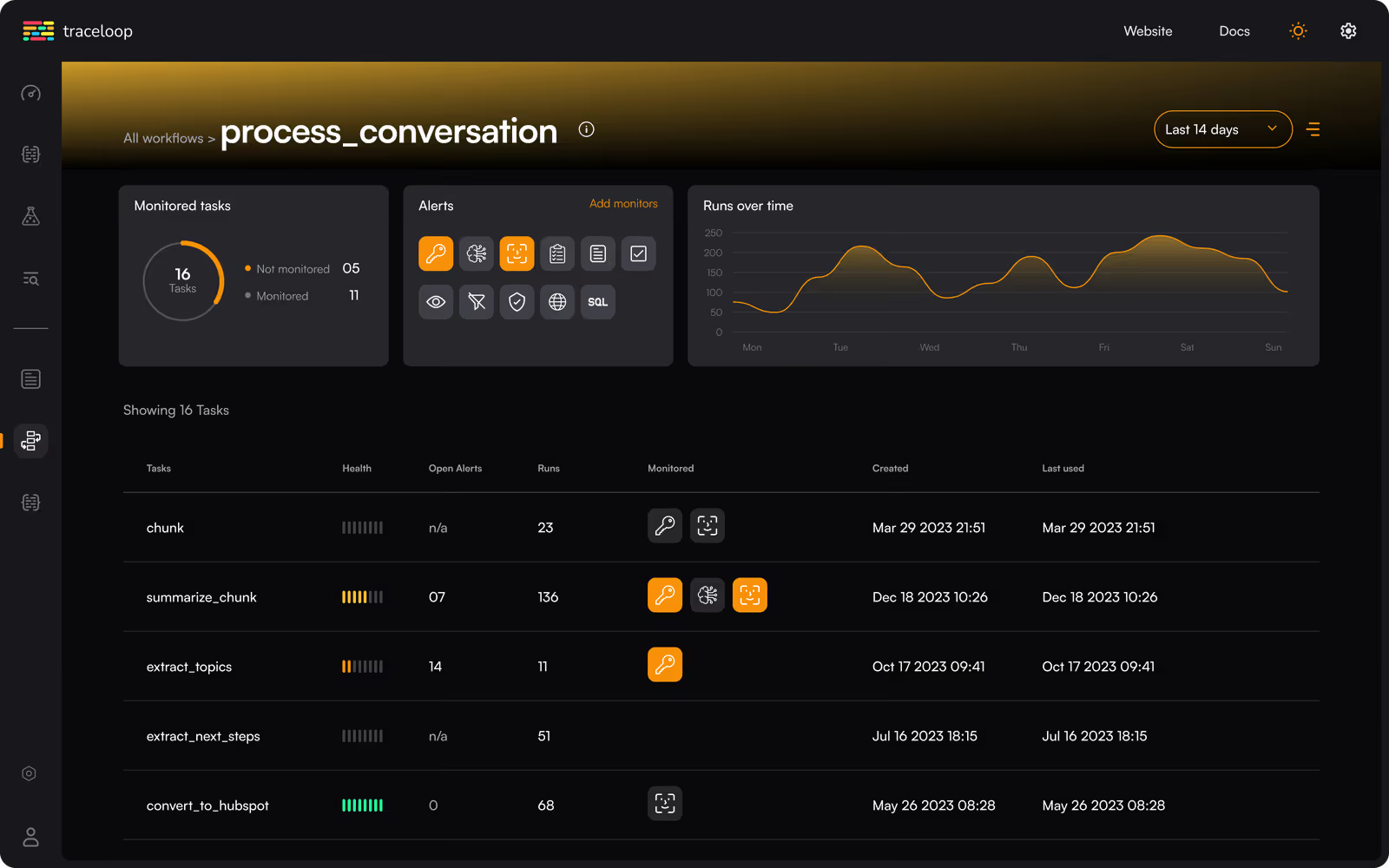

7. Traceloop (OpenLLMetry)

Résumé :

Un SDK open source basé sur OpenTelemetry, fournissant une collecte de données standardisée pour l'observabilité des modèles d'IA.

Caractéristiques :

- Prise en charge de divers LLM, d'une ingénierie rapide et de cadres de chaînage

- Capture d'indicateurs de performance clés (KPI) à partir de divers cadres d'IA

- Intégration avec des plateformes d'observabilité telles que Dynatrace

- Suivi des jetons et utilisation rapide en production

- Intégration parfaite avec les systèmes existants

- Prise en charge des frameworks LLM et des bases de données vectorielles les plus populaires

8. Opik

Résumé :

Une plateforme d'évaluation LLM de bout en bout open source développée par Comet, conçue pour les développeurs qui créent des applications basées sur LLM.

Caractéristiques :

- Enregistrement des traces et des spans pour les applications LLM

- Métriques d'évaluation préconfigurées et personnalisées

- Juges LLM pour des questions complexes telles que la détection des hallucinations

- Intégration avec les pipelines CI/CD pour des tests automatisés

- Surveillance et analyse de la production

- Compatibilité avec divers LLM et frameworks de développement

- Annotation manuelle et comparaison des réponses LLM

9. De toute évidence

Résumé :

Une bibliothèque Python open source pour l'évaluation et l'observabilité du ML et du LLM, prenant en charge divers types de données et systèmes d'IA.

Caractéristiques :

- Plus de 100 métriques intégrées pour la détection de la dérive des données et l'évaluation LLM

- Prise en charge des données tabulaires, textuelles et intégrations

- Rapports et suites de tests personnalisables

- Tableau de bord de surveillance en temps

- Intégration avec les pipelines ML existants

- Évaluation de systèmes prédictifs et génératifs

- Architecture ouverte pour faciliter l'exportation des données et l'intégration des outils

.avif)