Commencez votre aventure avec l’IA dès aujourd’hui

- Accédez à plus de 100 API d’IA sur une seule plateforme.

- Comparez et déployez des modèles d’IA en toute simplicité.

- Paiement à l’usage, sans frais initiaux.

Une passerelle IA est une couche de contrôle qui aide les développeurs à se connecter à plusieurs modèles d'IA via une seule API tout en gérant le routage, la sécurité, l'observabilité et les coûts. Dans cet article, nous expliquons ce qu'est une passerelle IA, comment elle fonctionne, ses principales fonctionnalités, ses avantages, les différences entre une passerelle IA et une passerelle API et les meilleurs cas d'utilisation des deux passerelles.

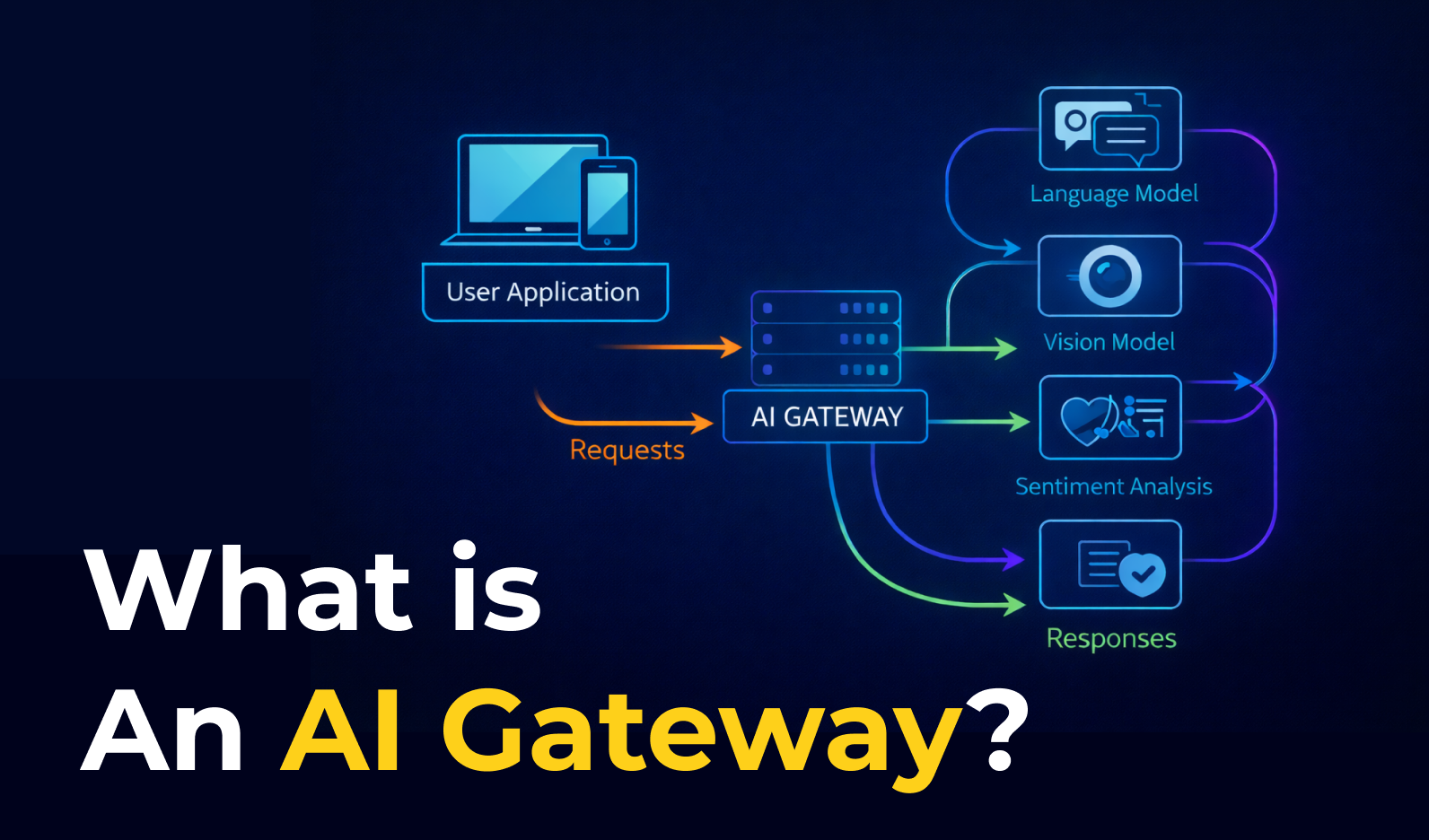

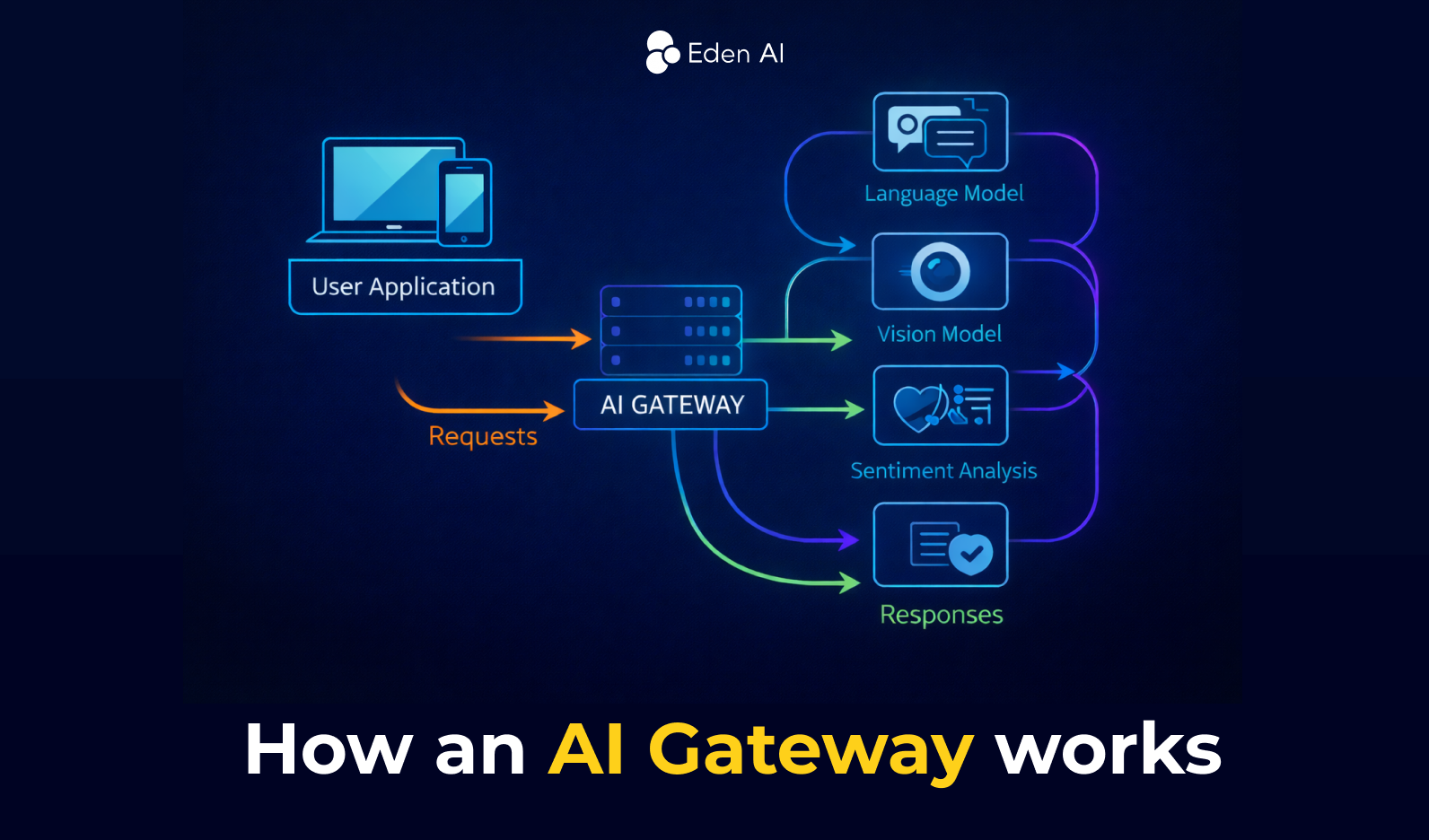

Un AI Gateway est une plateforme qui aide les entreprises et les développeurs à connecter, gérer et utiliser plusieurs modèles d’IA via une seule interface. Au lieu d’intégrer des API séparées de fournisseurs comme OpenAI, Anthropic ou Google, les utilisateurs peuvent y accéder depuis une plateforme unique.

Par exemple, au lieu de se connecter individuellement à OpenAI, Claude et Gemini, une entreprise peut utiliser un AI Gateway pour accéder aux trois au même endroit. Cela devient encore plus utile dans des cas d'utilisation les plus avancés. Une entreprise peutvouloir utiliser un modèle pour répondre aux questions des clients, un autre pour détecter le sentiment dans les messages, et un autre pour analyser les images envoyées par les utilisateurs.

Un AI Gateway agit comme une couche entre votre application et les modèles d'IA que vous utilisez. Chaque requête passe par la passerelle avant d’atteindre le modèle.

D'abord, lorsqu'un utilisateur envoie une requête, le AI Gateway la reçoit. Par exemple, un client peut envoyer un retour à votre application contenant à la fois du texte et une image.

Suivant, la passerelle traite la requête et décide où chaque partie doit être envoyée. Elle peut envoyer le texte à un large language model, l'image à un modèle de vision, et le même message à un modèle d'analyse de sentiment. En même temps, elle peut appliquer des règles comme l’authentification, les contrôles de sécurité et le filtrage des données.

Enfin, une fois que les modèles renvoient leurs résultats, le AI Gateway combine les résultats dans une réponse standardisée et la renvoie à l’application.

Un AI Gateway fournit un ensemble de fonctionnalités principales qui permettent de gérer la manière dont les applications accèdent et utilisent les modèles d’IA.

Il offre une API unifiée pour se connecter à plusieurs fournisseurs, route les requêtes vers le modèle approprié, applique des politiques de sécurité et d’usage, surveille les performances et les coûts, et garantit des opérations IA scalables et fiables depuis une couche de contrôle centralisée.

Un AI Gateway expose un seul endpoint API standardisé pour plusieurs modèles et fournisseurs d’IA. Cette interface unifiée masque les différences entre les API des fournisseurs, ce qui facilite l’intégration et le changement de modèles sans modifier le code de l’application.

La passerelle décide quel modèle d’IA doit traiter chaque requête. Elle peut router dynamiquement les requêtes selon la performance, le coût ou le cas d’usage, tout en gérant le cycle de vie des modèles comme le déploiement, le versioning, les mises à jour et les rollbacks.

Les AI gateways appliquent l’authentification, l’autorisation et le chiffrement pour protéger les systèmes d’IA. Elles peuvent filtrer les données sensibles, empêcher les attaques par injection de prompt et appliquer des politiques contrôlant l’accès à certains modèles ou datasets.

La passerelle aide à gérer la consommation d’IA grâce au rate limiting, aux quotas et au suivi des tokens. Cela permet aux équipes de surveiller l’usage et d’éviter des coûts excessifs lors de l’utilisation de fournisseurs d’IA externes.

Les AI gateways suivent des métriques de performance telles que la latence, les erreurs, l’utilisation des tokens et le volume de requêtes. Les logs centralisés et les dashboards offrent une visibilité sur l’activité IA, aidant les équipes à détecter rapidement les problèmes et à optimiser les performances.

Avant d'envoyer des requêtes aux modèles, la passerelle peut nettoyer, normaliser, enrichir ou transformer les données. Cela inclut l'ajout de contexte aux prompts, le filtrage d'informations sensibles ou la mise en forme des données pour assurer une compatibilité entre différents modèles.

Les AI gateways gèrent le load balancing et le déploiement scalable des modèles, en s’assurant que les requêtes sont distribuées entre les différentes instances disponibles. Cela permet une inférence fiable en temps réel ou en batch même lorsque la charge augmente.

Utiliser un AI Gateway aide les équipes à gérer les modèles d’IA de manière plus sécurisée et efficace en contrôlant tout depuis une seule couche, au lieu de construire une infrastructure complexe pour le routage, le monitoring et la sécurité.

Les passerelles IA protègent les applications en appliquant des politiques d'authentification, de contrôle d'accès basé sur les rôles (RBAC), de gestion des informations d'identification et de protection des données. Ils réduisent le risque de fuites de données sensibles et contribuent à la défense contre les menaces telles que l'injection rapide ou l'utilisation malveillante d'API.

es AI gateways protègent les applications en appliquant l’authentification, le contrôle d’accès basé sur les rôles (RBAC), la gestion des identifiants et des politiques de protection des données.

Elles réduisent les risques de fuite de données sensibles et aident à se défendre contre des menaces comme l’injection de prompt ou l’usage malveillant des API.

Les AI gateways équilibrent automatiquement le trafic entre les instances de modèles, optimisent l’utilisation des ressources et maintiennent des performances stables lorsque les charges de travail IA augmentent.

Les passerelles suivent des métriques comme la latence, les erreurs, l’utilisation des tokens et l’activité des modèles. Cette visibilité aide les équipes à détecter les problèmes plus tôt et à optimiser les coûts et les performances.

EEn s’intégrant aux pipelines CI/CD et aux workflows DevOps, les AI gateways permettent une expérimentation plus rapide, des mises à jour plus simples et un déploiement plus rapide de fonctionnalités basées sur l’IA.

Les AI gateways offrent un accès unifié à différents modèles et fournisseurs d’IA, permettant aux équipes de tester, changer ou combiner des modèles rapidement lors de la création de nouvelles applications IA.

Un API Gateway est conçu pour les API d’applications traditionnelles, tandis qu’un AI Gateway est conçu pour les charges de travail liées à l’IA et ajoute des fonctionnalités comme le routage de modèles, le suivi des tokens, la sécurité des prompts et le contrôle des coûts.

Un AI Gateway est le meilleur choix lorsque votre application repose sur des LLM ou d'autres modèles d'IA. Il ajoute des fonctionnalités spécifiques à l'IA, telles que le routage des modèles, le fallback entre fournisseurs, le suivi des tokens, le filtrage des prompts, le masquage des données et le monitoring des coûts liés à l’IA.

Cas typiques :

Un API Gateway est le bon choix lorsque votre application se connecte principalement à des services backend, des bases de données ou des microservices via des API traditionnelles.

Il aide à gérer le routage des requêtes, l’authentification, le rate limiting, le caching et le monitoring.

Cas typiques :

Choisir le bon AI Gateway en 2026 nécessite d’évaluer différents facteurs critiques au-delà du simple routage de modèles. Voici 10 critères clés à prendre en compte lors de la comparaison de différents AI Gateways :

Lors du choix d’un AI Gateway, les équipes qui construisent des systèmes d’IA en production devraient privilégier la performance, la fiabilité et l’observabilité, tandis que les entreprises peuvent accorder plus d’importance à la gouvernance, la conformité et l’intégration dans leur écosystème. Les startups et les développeurs testant plusieurs modèles peuvent privilégier la couverture des fournisseurs, la flexibilité et la facilité d’intégration.

Le meilleur AI Gateway en 2026 dépend de votre configuration : certaines plateformes sont conçues pour la performance en edge, d’autres pour la gouvernance d’entreprise, et d’autres pour l’expérimentation rapide.

Un API Gateway gère le trafic API standard entre les clients et les services backend, tandis qu’un AI Gateway est conçu spécifiquement pour les charges de travail liées à l’IA comme les prompts LLM, les réponses des modèles, les embeddings et le routage vers des fournisseurs d’IA.

Vous devriez utiliser un AI Gateway lorsque votre application s’appuie sur des modèles d’IA en production, surtout si vous avez besoin de routage de modèles, de fallback entre fournisseurs, de suivi de l’utilisation des tokens, de sécurité des prompts ou de contrôle des coûts liés à l’IA.

Un API Gateway est le bon choix lorsque vous devez gérer des API traditionnelles, des microservices, l’authentification, le rate limiting, le caching et le trafic backend pour des applications web ou mobiles.

Pas forcément, mais cela peut rester utile. Même avec un seul fournisseur, un AI Gateway peut améliorer la sécurité, l’observabilité, la gouvernance et le monitoring des coûts, surtout dans des environnements de production.

Pas toujours. Un AI Gateway est conçu pour le trafic spécifique à l’IA, tandis qu’un API Gateway gère les API d’applications générales. De nombreuses entreprises utilisent les deux : l’un pour les services backend et l’autre pour les interactions avec les modèles d’IA.

Vous pouvez commencer à construire tout de suite. Si vous avez des questions, n'hésitez pas à discuter avec nous !

CommencezContactez le service commercial