Résumez cet article avec :

Compréhension Requesty et LLMs

Les Large Language Model (LLM) sont devenus des outils essentiels pour les développeurs, les entreprises et les chercheurs, car ils alimentent des applications telles que les chatbots, la création de contenu et le support client. LLM populaires incluent le GPT-5 d'OpenAI, Claude d'Anthropic, le LLama de Meta et le Mixtral de Mistral.

Pour intégrer ces modèles, les développeurs y accèdent généralement via une API, mais la gestion de plusieurs comptes, de la facturation et des clés d'API peut s'avérer fastidieuse. Les agrégateurs de modèles résolvent ce problème en proposant une API unique permettant de basculer facilement entre les différents LLM.

Requesty est l'une de ces solutions, qui permet d'accéder à plusieurs fournisseurs d'IA via une API unifiée. Il simplifie l'intégration en acheminant les demandes vers différents modèles à partir d'un seul point de terminaison. Cependant, Requesty n'est pas la seule option.

Plusieurs alternatives offrent aujourd'hui de meilleurs prix, plus de flexibilité ou des fonctionnalités d'entreprise spécialisées. Parmi celles-ci, Eden AI se distingue comme la meilleure alternative à Requesty, offrant un accès à l'IA rentable, une évolutivité de niveau entreprise et une prise en charge des modèles propriétaires et open source.

Meilleures alternatives à Requesty pour l'accès à l'API LLM

1. Eden AI

Eden AI est bien plus qu'un simple agrégateur de modèles. Il s'agit d'une plateforme d'IA complète qui permet aux développeurs d'accéder à des dizaines de fournisseurs et de services via une seule API. En plus de principaux LLM tels que GPT-5, Claude, LLama et Mixtral, il prend en charge un large éventail de fonctionnalités, notamment traduction, bavarder, génération d'images, synthèse vocale, et bien plus encore. Cela en fait un choix judicieux pour les équipes qui souhaitent combiner différentes fonctionnalités d'IA sans avoir à gérer plusieurs comptes et intégrations.

Eden AI se distingue par son moteur d'optimisation des coûts. Chaque demande peut être acheminée vers le fournisseur le plus efficace et le plus abordable, ce qui permet de réduire les dépenses tout en maintenant des résultats de haute qualité. En outre, la fiabilité est intégrée à la mise en cache, aux fournisseurs de solutions de secours et à la surveillance de l'utilisation afin d'éviter les pannes inutiles ou les frais de duplication.

Contrairement à Requesty, Eden AI est conçu dans un souci de flexibilité. Il n'y a pas de dépendance vis-à-vis d'un fournisseur, ce qui signifie que les développeurs peuvent facilement expérimenter de nouveaux modèles dès leur sortie. Que votre priorité soit le prix, les performances ou l'accès aux dernières innovations, Eden AI facilite le changement de fournisseur, la positionnant comme l'alternative la plus adaptable et la plus pérenne à Requesty.

2. PortKey

Portkey est une autre alternative solide à Requesty, conçue pour aider les développeurs à gérer et à optimiser l'utilisation de LLM à grande échelle. Il prend en charge l'intégration avec plusieurs fournisseurs d'IA et propose des fonctionnalités avancées telles que le routage intelligent, la mise en cache et la limitation de débit. L'un de ses principaux avantages est sa capacité à acheminer automatiquement les demandes vers le modèle le plus adapté, en équilibrant coût, rapidité et fiabilité.

Au-delà du routage, Portkey inclut également des fonctionnalités d'optimisation des coûts, telles que la mise en cache des requêtes répétées et des outils de surveillance qui fournissent aux développeurs des informations claires sur l'utilisation et les performances. Cela permet d'identifier plus facilement les goulots d'étranglement, de contrôler les dépenses et de prendre des décisions fondées sur des données.

Grâce à son API conviviale pour les développeurs, l'intégration est simple, ce qui permet aux équipes de démarrer rapidement. Portkey propose également une tarification différenciée, y compris un niveau gratuit avec une utilisation limitée pour les expériences et des forfaits premium pour les besoins plus volumineux. Pour les entreprises qui recherchent une alternative rentable et optimisée à Requesty, Portkey est un choix judicieux.

3. LiteLLM

LiteLLM est une alternative open source à Requesty, conçue pour les développeurs qui souhaitent un contrôle et une transparence optimaux sur leurs intégrations d'IA. Au lieu de vous fier à un service géré, LiteLLM vous permet d'héberger et de gérer vous-même vos propres demandes d'API, ce qui vous donne la liberté de choisir votre infrastructure et d'éviter toute dépendance vis-à-vis d'un fournisseur.

L'un des principaux atouts de LiteLLM est sa flexibilité. Les entreprises peuvent le déployer sur leur fournisseur de cloud préféré, configurer des règles de routage personnalisées et conserver un contrôle total sur la confidentialité et la sécurité des données. Cela en fait une option intéressante pour les équipes soumises à des exigences de conformité strictes ou pour celles qui souhaitent personnaliser leur stack d'IA sans être liées à une plateforme tierce telle que Requesty.

LiteLLM est gratuit et open source, disponible directement sur GitHub et soutenu par une communauté de développeurs active. Cependant, sa configuration et sa gestion nécessitent plus d'expertise technique que les plateformes gérées. Pour les équipes désireuses d'investir dans cet effort de configuration, LiteLLM propose une alternative hautement personnalisable et transparente à Requesty.

4. OpenRouter

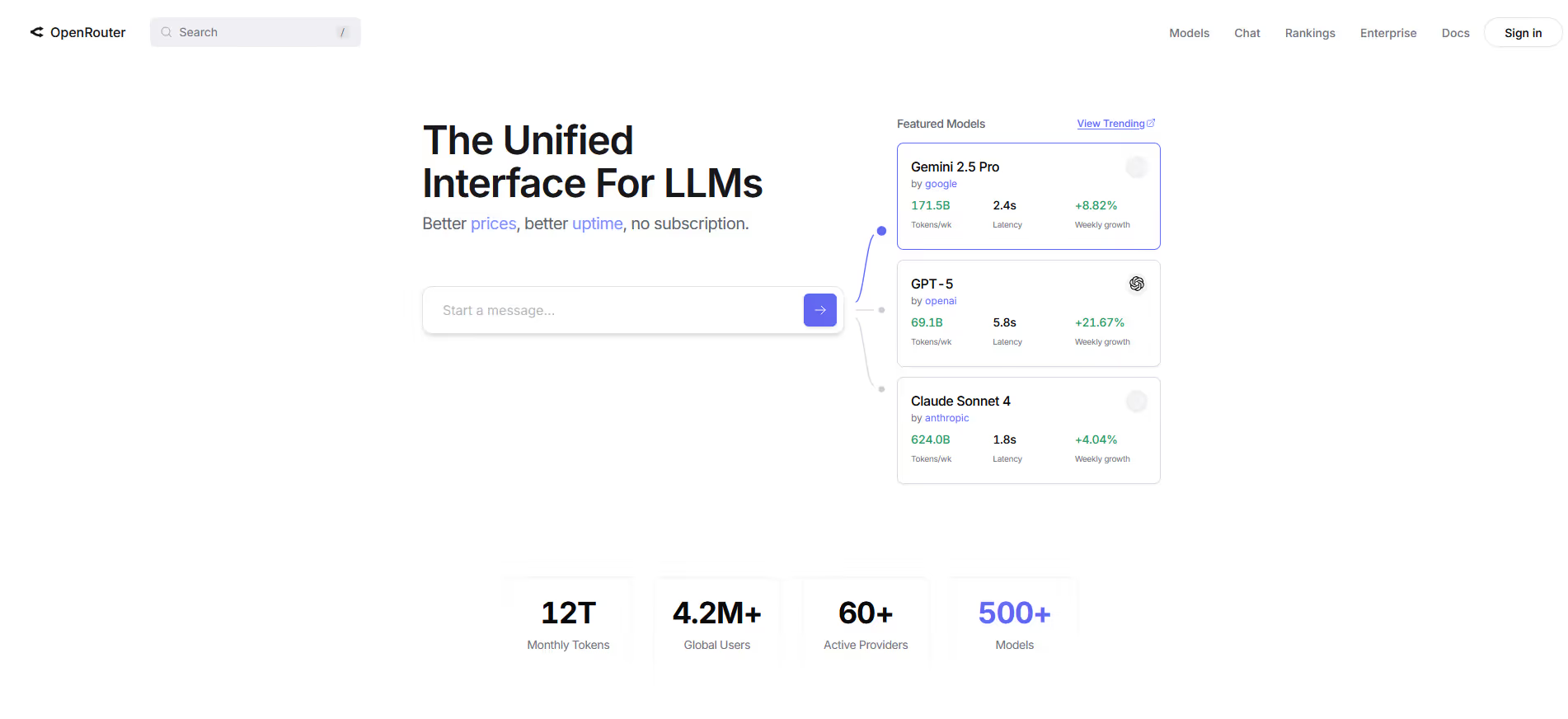

OpenRouter est l'un des agrégateurs LLM les plus utilisés, permettant aux développeurs d'accéder à plusieurs fournisseurs via une seule API. Il prend en charge des modèles tels que GPT-5, Claude, LLama et Mixtral, et facilite l'acheminement des demandes entre eux sans gérer de comptes ou de clés distincts.

Ses points forts sont sa facilité d'intégration et une large communauté de développeurs qui s'appuie déjà sur elle. Cependant, OpenRouter se concentre principalement sur les modèles de texte et n'offre pas les services multimodaux plus larges (tels que l'OCR, la synthèse vocale ou la traduction) proposés par certaines alternatives.

Pour les équipes dont l'objectif principal est un accès rapide et fiable aux meilleurs LLM, OpenRouter reste une alternative solide à Requesty.

5. Kong AI Gateway

Kong AI Gateway est une extension open source de Kong Gateway qui facilite l'intégration et la gestion de plusieurs LLM via une seule API. Il prend en charge les principaux fournisseurs tels qu'OpenAI, Anthropic, Cohere, Mistral et LLama de Meta, permettant aux développeurs de basculer entre les modèles sans modifier le code de leur application.

Certaines de ses fonctionnalités clés incluent la gestion centralisée des informations d'identification, des métriques en temps réel, des intégrations d'IA sans code et une ingénierie rapide avancée. Ensemble, ces fonctionnalités aident les entreprises à rationaliser l'adoption de l'IA tout en maintenant de solides contrôles de sécurité, de gouvernance et de conformité.

En tant qu'alternative gratuite et auto-hébergée à Requesty, Kong AI Gateway offre une évolutivité et une personnalisation complète aux équipes qui souhaitent gérer leur propre infrastructure. Cependant, contrairement aux services gérés tels que Requesty, il nécessite une configuration plus poussée et une maintenance continue, ce qui n'est peut-être pas idéal pour les entreprises à la recherche d'une solution prête à l'emploi. Pour les équipes qui accordent la priorité au contrôle, à la confidentialité et à la conformité, Kong AI Gateway est une option intéressante.

Conclusion

Bien que Requesty soit une option populaire pour accéder à plusieurs LLM via une seule API, il existe plusieurs alternatives solides offrant de meilleurs prix, une meilleure flexibilité et de meilleures fonctionnalités. Le bon choix dépend de vos priorités, qu'il s'agisse de l'accessibilité, de la gouvernance de niveau entreprise, de l'évolutivité ou de l'accès open source.

Parmi elles, Eden AI s'impose comme la meilleure alternative. Avec son API unifiée, son routage optimisé en termes de coûts, sa prise en charge multimodale de l'IA et son absence de dépendance vis-à-vis d'un fournisseur, Eden AI permet aux entreprises et aux développeurs d'accéder facilement à une large gamme de services d'IA sans devoir jongler avec plusieurs fournisseurs. En choisissant Eden AI, vous avez accès aux derniers modèles tels que GPT-5 ainsi qu'à des options open source, tout en maîtrisant les coûts et en garantissant une flexibilité à long terme.

Que vous créiez des chatbots, des outils de recherche, des assistants alimentés par l'IA ou des flux de travail automatisés, Eden AI garantit l'accès aux modèles les plus performants et les plus rentables, le tout sans avoir à gérer des intégrations distinctes.