Groq

Inférence LLM ultra-rapide pour des applications IA en temps réel

Qu'est-ce Groq?

Groq est conçu pour les développeurs qui recherchent des performances extrêmes en inférence IA à grande échelle. Grâce à son hardware LPU propriétaire, Groq offre une latence bien plus faible que les solutions traditionnelles basées sur GPU, ce qui le rend particulièrement adapté aux cas d’usage en temps réel.

Compatible avec les principaux LLM open source, Groq excelle dans des tâches comme l’IA conversationnelle, la génération de texte ou les réponses en streaming. C’est une solution idéale pour les produits où la vitesse et la réactivité sont des critères clés.

Ils utilisent Groq

Valeur ajoutée

Gagnez du temps

Intégrez une seule fois, puis accédez à des centaines de modèles sans avoir

à gérer plusieurs API.

Les mises à jour des modèles, les changements de fournisseurs et les nouvelles versions sont gérés automatiquement, en toute transparence.

Réduisez les coûts

Utilisez le modèle le plus efficace pour chaque besoin. Évitez la dépendance à un fournisseur et adaptez-vous rapidement aux évolutions de prix ou de performances.

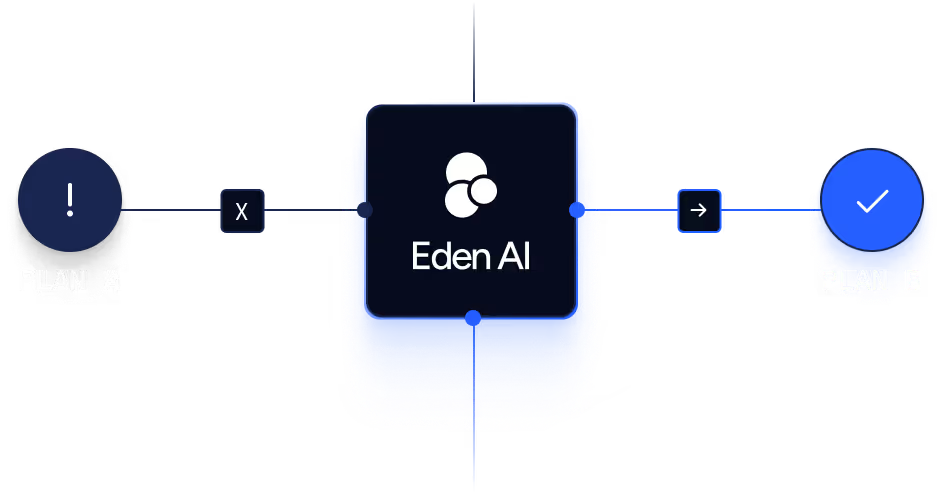

Réduisez les risques

Des mécanismes de basculement intégrés protègent les applications contre les défaillances des modèles. La flexibilité du routage permet de s’adapter rapidement à l’évolution des technologies et des fournisseurs.

Commencez à créer avec Eden AI

Une interface unique pour intégrer les meilleures technologies d’IA dans vos flux de travail.